用于融合预训练语言模型的工具包

大家好,又见面了,我是 GitHub 精选君!

项目背景

在自然语言处理领域,语言模型预训练是一个常见的任务。然而,如何有效的融合多个预训练语言模型,仍然是一个开放性的问题。传统方法通常只能简单地通过线性方式混合不同模型的输出,这种方式考虑的信息较为有限,不能很好地对模型中的深层信息进行整合。此外,由于语言模型中包含多个层,而各层之间的相互作用、依赖关系也是模型能否取得好效果的关键。因此,如何在融合模型时,将这些层级信息进行有效整合,是现阶段亟待解决的问题。

今天要给大家推荐一个 GitHub 开源项目 cg123/mergekit,该项目在 GitHub 有差不多 1000 Star,用一句话介绍该项目就是:“Tools for merging pretrained large language models.”。

项目介绍

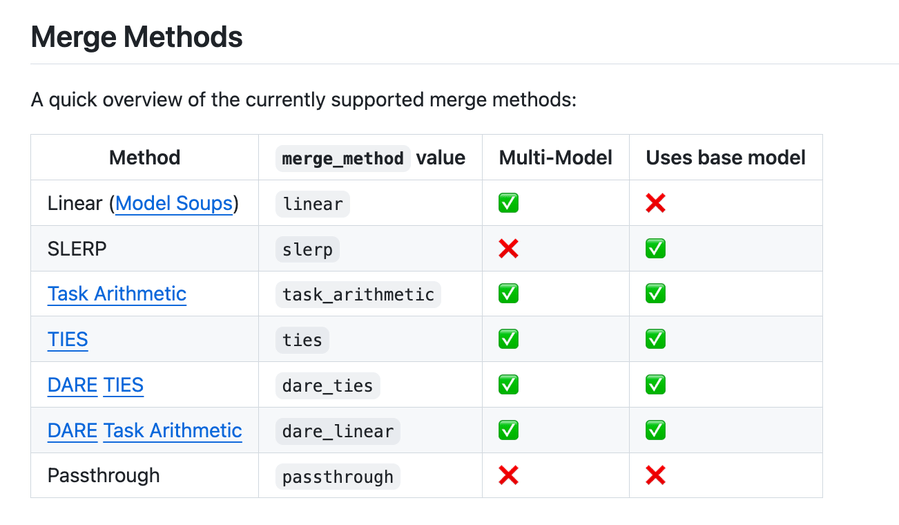

mergekit 是一个用于融合预训练语言模型的工具包,采用多种融合方法,包括 TIES、线性和 slerp 融合。该工具还使得从各层中选择性地组装语言模型成为可能。此外,配置文件中包含了大量可以自定义的字段,如融合方法、层级划分、模型选择、参考模型选择、参数设置等,无论是整体调整还是微观调整,都可以通过配置文件方便快捷的完成。

如何使用

首先,你可以通过如下命令进行安装。

git clone https://github.com/cg123/mergekit.git

cd mergekit

pip install -e . # install the package and make scripts available

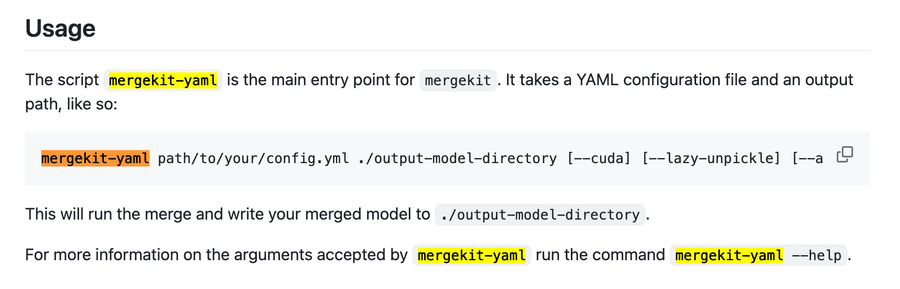

下载并安装好项目后,就可以通过编写 YAML 配置文件来指定合并操作的具体行为和参数等。创建好配置文件后,运行 mergekit-yaml 即可开始你的合并操作。

项目推介

该项目解决了融合预训练大型语言模型的问题,为研究人员、开发者提供了一个方便快捷的工具,使得它们可以更加高效地进行模型的融合和变形操作。在项目的 README 中,作者也提供了丰富的示例和详细的参数配置说明,使得入手变得非常易懂。

以下是该项目 Star 趋势图(代表项目的活跃程度):

更多项目详情请查看如下链接。

开源项目地址:https://github.com/cg123/mergekit

开源项目作者:cg123

以下是参与项目建设的所有成员:

关注我们,一起探索有意思的开源项目。

更多精彩请扫码关注如下公众号。